先说基本情况,省流版本先上:

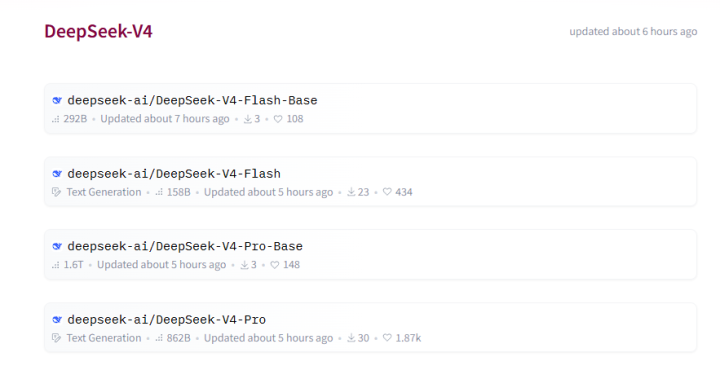

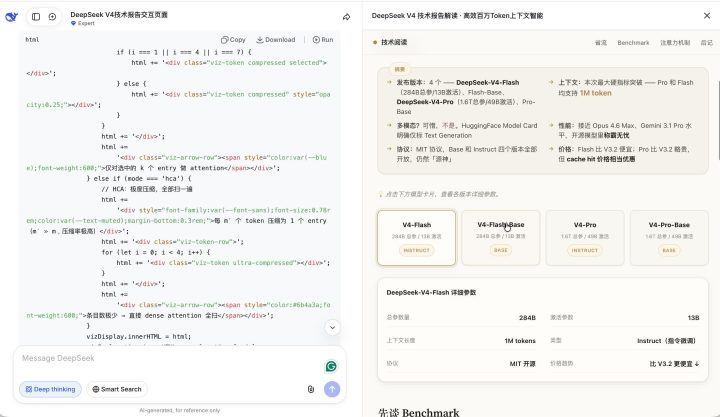

- 发了几个版本? 4个。DeepSeek-V4-Flash(284B 总参/13B 激活)、DeepSeek-V4-Flash-Base、DeepSeek-V4-Pro(1.6T 总参/49B 激活)、DeepSeek-V4-Pro-Base,全部支持 1M context。DeepSeek依然还是「源神」,模型和技术报告同步开放,MIT 协议,一次性把 Base 和 Instruct 四个版本全给你了。

- 上下文? 这是本次最大的硬指标突破之一:pro和flash都有1M token。

- 是否多模态?可惜,不是。(我之前还在一个回答里猜它可能是多模态)。HuggingFace Model Card 里明确只标了 Text Generation,暂时别被外面的「多模态」说法带跑了。

- 性能呢?说不上SOTA,接近Opus 4.6 Max, Gemini 3.1 pro水平,但在开源模型里,谈称霸是没问题的。性能的Benchmark太多了,后面展开说。

- 价格怎么样?Flash的话,比3.2版本便宜,pro的话,比3.2版本贵点。但cache hit 价格相当优惠—

模型 & 价格

下表所列模型价格以“百万 tokens”为单位。Token 是模型用来表示自然语言文本的的最小单位,可以是一个词、一个数字或一个标点符号等。我们将根据模型输入和输出的总 token 数进行计量计费。

模型细节

| 模型 | deepseek-v4-flash* | deepseek-v4-pro | |

| BASE URL (OpenAI 格式) | https://api.deepseek.com | ||

| BASE URL (Anthropic 格式) | https://api.deepseek.com/anthropic | ||

| 模型版本 | DeepSeek-V4-Flash | DeepSeek-V4-Pro | |

| 思考模式 | 支持非思考与思考模式(默认) 切换方式详见思考模式 |

||

| 上下文长度 | 1M | ||

| 输出长度 | 最大 384K | ||

| 功能 | Json Output | 支持 | 支持 |

| Tool Calls | 支持 | 支持 | |

| 对话前缀续写(Beta) | 支持 | 支持 | |

| FIM 补全(Beta) | 仅非思考模式支持 | 仅非思考模式支持 | |

| 价格 | 百万tokens输入(缓存命中) | 0.2元 | 1元 |

| 百万tokens输入(缓存未命中) | 1元 | 12元 | |

| 百万tokens输出 | 2元 | 24元 | |

* deepseek-chat 与 deepseek-reasoner 两个模型名将于日后弃用。出于兼容考虑,二者分别对应 deepseek-v4-flash 的非思考与思考模式。

本地运营方法

请参阅推理文件夹,了解本地运行 DeepSeek-V4 的详细说明,包括模型权重转换和互动聊天演示。

对于本地部署,我们建议将抽样参数设置为 。对于 Think Max 推理模式,我们建议将上下文窗口设置为至少 384K token。temperature = 1.0, top_p = 1.0

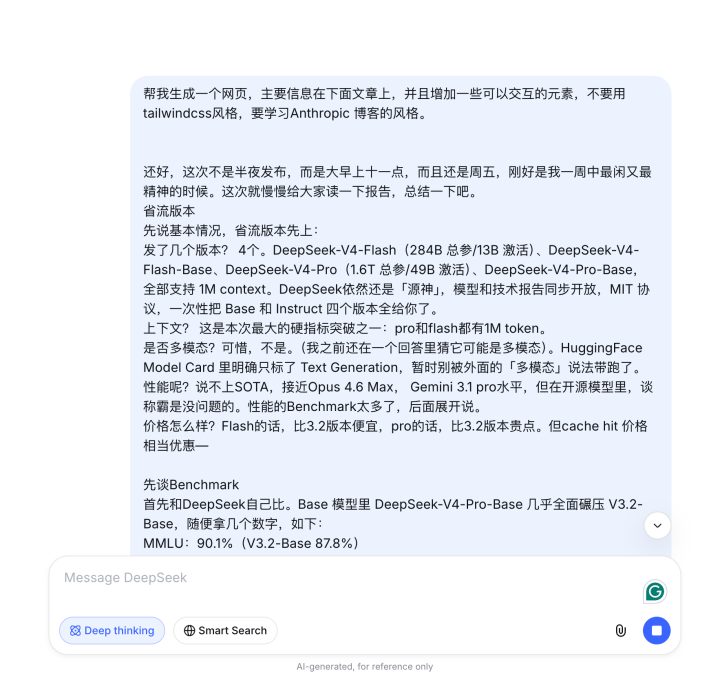

不过,Coding是这次升级点之一,就试试Coding能力,看看能不能做个好看的网页

看它思考过程

最终输出结果,真的和普通的tailwindcss味道不一样,很像Anthropic风格(差不多10分钟才输出完

后记

大家注意到没有,DeepSeek V4 的技术报告副标题是「Towards Highly Efficient Million-Token Context Intelligence」。

可以看到DeepSeek依然还是走效率路线,DeepSeek 不再只在「能力 benchmark」上跟 OpenAI ,Anthropic,Gemini等公司正面竞争了,而是在「高效长上下文推理」这条赛道上切入。

我个人觉得,DeepSeek 下一步真正的壁垒不是总参数规模,是 inference 效率。V4-Pro 在 1M token 下只用 V3.2版本的27%的 FLOPs,KV cache 压缩到 10%,这背后意味着什么?意味着他们能在同等算力预算下 serve 更多请求,API 定价可以继续往下压。这跟 Anthropic、OpenAI 的商业逻辑是不同路的打法。

(当然,,目前算力还不够,价格还不够低,但DeepSeek说后续价格还会降的)

长期来看,利好有能力自部署的大型企业和开发者社区;闭源模型如果不在 inference 效率上持续创新,价格压力会越来越大。